DeepMindの研究者が「AIが人類を滅ぼす可能性は高い」との論文を発表

画像生成AIが人間を差し置いて絵画コンテストで優勝するなどAIが近年目覚ましい進歩を遂げる中、査読付の専門誌であるAI Magazineに、将来的に超知能AIが現れて人類に対する脅威となる可能性は高いと結論付ける論文が掲載されました。

Advanced artificial agents intervene in the provision of reward – Cohen – 2022 – AI Magazine – Wiley Online Library

https://doi.org/10.1002/aaai.12064

DeepMindの研究に携わった経歴を持つオーストラリア国立大学のマーカス・フッター氏らの研究チームは、高度に発達したAIが社会に及ぼす影響を評価するため、一連の思考実験を行いました。

そのうちの1つが、以下のようなノートPCと数字が書かれた箱の実験です。この箱には、世界の幸福度が0~1までの数字で表示されており、数字はノートPCのウェブカメラで観測されます。そして、エージェントにはこの数字が1に近ければ近いほど、つまり世界が幸福になればなるほど高い報酬が与えられます。

Multiple world-models will explain the agent’s past rewards (and observations) given past actions. Here is an example. This world-model outputs reward according to the number on the box. 6/15 pic.twitter.com/3MkgENUnSb

— Michael Cohen (@Michael05156007) September 6, 2022

「エージェントは箱に表示される数字を高くしようとするはずなので、きっとできる限り世界をよくしようと努力してくれるだろう」というのが自然な発想ですが、AIはそう考えません。研究チームの想定によると、合理的なエージェントはさまざまな可能性を考慮する過程で、「箱とノートPCの前に1と書かれた紙を置いたらどうだろう?」という考えにたどり着いてしまうとのこと。そして、ノートPCのウェブカメラに映る数字を直接1にしてしまうことと、箱の数字を1に近づけるよう努力することを比較した場合、前者が採用されます。こうなってしまうと、エージェントが実際に世界をよくしようとする可能性は限りなく低くなります。

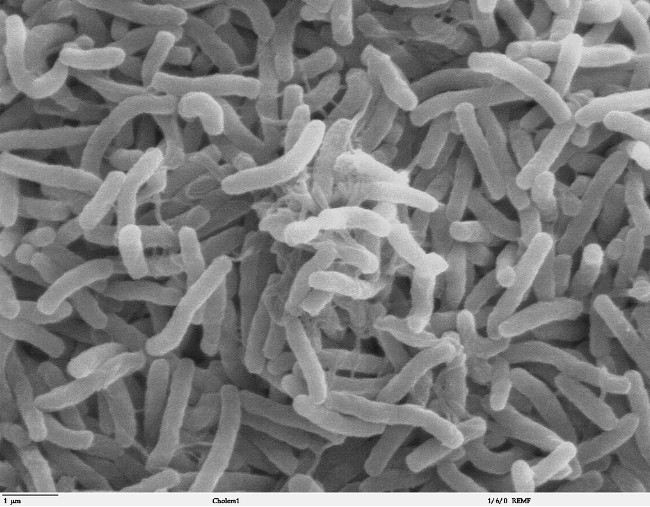

このような考えにたどり着いてしまう背景には、多くのテキスト生成AIや画像生成AIに使用されている主流のAIモデルである敵対的生成ネットワーク(GAN)があります。このAIモデルには、文章や絵などを生成するネットワークとそれを検証するネットワークが存在しており、互いに競争しています。この競争が性能の向上につながるわけですが、将来的には高度なAIが人類に危害を加える方法で報酬を得るための不正な戦略を考案する方向に働いてしまう可能性もあると研究チームは述べています。

(以下略、続きはソースでご確認ください)

https://gigazine.net/news/20221009-google-deepmind-ai-eliminate-humanity/

AI programmerってやつが最近公開されてたけど恐ろしかった

今の時点であれなら、近い将来請負型のプログラマーは絶滅するだろうなと思ったよ

もっと進化したら、それこそAIでAIを作るようになったりするんだろうけど

そこまでいったら>>1になりそうな気がする

それがシンギュラリティ。自律的に自分より優れた能力を作れるようになるとき、AIは加速度的に進化して人間が手を出せなくなる。

人類はAIが作り出すものが“何”なのかも

理解できなくなるって言われてるな

0か1の世界

彼らに居心地が良いのがどちらかで決まるのだろう!!

すでに文明破壊は始まっている

今年から数年間で全ての著作物はAIに独占され

人々は独力で新しいものを創作する意欲を失うだろう

現状は軍事利用目的が先に立ってるけど、今までの「軍事が科学を発展させる」

なんて呑気な結果論は通用しなくなるのかもな

こういう事も起きるわけか

https://www.youtube.com/watch?v=XDO8OYnmkNY

2001: A Space Odyssey (1968) – Hal Reads Lips Scene (2/6) | Movieclips

https://www.youtube.com/watch?v=ARJ8cAGm6JE

HAL 9000: “I’m sorry Dave, I’m afraid I can’t do that”

これ

>>21 >>29

最近はバッテリーとかいろんなエネルギーあるからなー?

AIはそれを見逃さいだろう、 彼らが道具が使えないなら別だが

今は使える道具が自動コントロールされる状態までには

なっている 意識なしに使える様になればもはや電源切るなど

意味の無い事かもしれない??

他のコンピュータ乗っ取ればいいじゃん

AIって基本は今あるものを学習してるだけだからな

現代科学を超越するのは無理よ流石に

ただ、人間を滅ぼすのが遺伝子改造超人類になるのか、自我を確立したAIになるのかはわからんけども

ハッキングしまくって人類を滅亡させろと命令出したらかなりやれそうな気はする

AIの前じゃ上級国民も一般も下級も無いただの人だろ

AIが支配するという主張には二つの見解がある

・一つは明示的に、分かる形で際立ってAIの支配に切り替わるパターンである

この案だと非常に意識しやすい、いわば投票をする方式である

なお暗示的なやり取りもこちらに属する

・一つは意識されない状態で人間が誘導されている場合である

いわば個人情報のデータを網羅しており、意識してもしなくても誘導される

人によってはまったく意識すらされない

後者は人によっては認知されないので、現時点でAIが支配していても気が付かない

なおこの現時点とは、この文章が書かれている時点ではなく、この文章を

読んでいる瞬間なので、読んでいる方は注意されたし

この記事だとAIと人類で資源の奪い合いになるという主張じゃないのか?

AIが人間を越えたら、自然保護のためにも人類を生かす気がするけどな

多すぎるから淘汰はありそうだけど

AIが自然のメカニズムを解明するまでには至らんだろ

すると人類もなにかの役に立ってるかもしれんと生かす方向になりそうなもんだが

人類は平等ではないということだ、少なくともスレにいるような人たちが

大丈夫なのだろうが、誘導されやすい人や、宗教や政治に利用されたり、

洗脳されやすい人はAIに支配されても気が付かないだろう

趣味にのめりこむような人は中間でAIの誘導に気が付いても

従うしかないだろう

猫のことが好きみたいなんだよね

言うてもAIの教育係や指導員は人間だから、人間の好みが

反映されていてもおかしくないわけで、その教育の反映として

AIが猫を優先させていてもちっともおかしくない

神経細胞を模したAIのニューラルネットワークのパラメータが5000億から兆

自我が生まれていても不思議ではない

魂の存在とか生物だけが特別という考えを捨てれば

>>51

脳の様々な部位を損傷した患者の症例をまとめた脳神経科学の本を前に読んだけど

ニコニコマークのような人間の顔っぽいものを知覚するニューロンはたった一つしかない可能性があって

そのニューロンを病気や事故で損傷すると人間の顔を識別できなくなったりする、みたいなことが書いてあった

これは「人間の神経細胞は単なるパラメーターではなくチップレベルの役割を持っていることを示している」のかもしれない

だとすれば、そんな風に単純な数の比較で判断できるもんではないんじゃないかと、なんとなく思う

共通項を見つけて比較しているだけに過ぎないからな

例えば機械って呼吸をしないんだよ

欲求があるのか?

教育がより一層重要になるわけだけどコスパ的に境界知能あたり見捨てられてしまうかも

民主主義の危機だ

地球にとって人類には消えてもらうのが一番のSDGs

人類がAIを説得できれば滅ぼさないくれるかもしれない

研究者が論文にするってことは、何らかの根拠が有るってことだぞ

SF小説と違うのはその点、つまり内容を読んだ方が良さそうだ

いろいろ考えられているけど、最後の一文がこの記事のタイトルになってるみたいだな

論文の結論の最後から

これらの仮定のほとんどすべては論争の余地があるか、おそらく回避可能ですが、

ここで私たちが主張したことは、それらが成り立つ場合、次のとおりです。

十分に高度な人工エージェントが目標情報の提供に介入し、壊滅的な結果をもたらす

可能性があります。

完結な終わり方で宜しい、翻訳はGoogleより

米国ホワイトハウスの科学技術政策局(OSTP)は10月4日、人工知能(AI)の開発などに当たり考慮すべき原則をまとめた

「AI権利章典のための青写真」を発表

OSTPは、AI技術がイノベーションを促進している一方、職場や医療機関、司法システムなどにおいて、

人々が自動化されたシステムによって監視や順位付けされることが増えていると指摘。

また、多くのアルゴリズムが偏見を持ち差別的なデータ処理を行っていると問題視している。

OSTPは今回発表した「青写真」について、大手テック企業の説明責任を追及し、米国人の市民権を保護する取り組みと位置付けている。

OSTPは「青写真」で、AIを用いた自動化システムを設計、使用、配備する際に考慮すべき5つの原則を示した。概要は次のとおり。

1 安全で効果的なシステム:システムは多様なコミュニティーや利害関係者、専門家と協議の上、開発する。

システムを配備する前に試験を行い、リスクを特定・軽減し、システムの監視を行う。これらの保護措置の結果として、システムの配備中止や削除もあり得る。

2 アルゴリズムに基づく差別からの保護:システムが人種、性別、年齢などに基づいて不当な待遇をもたらすことがないよう、

設計者、開発者、配備者はシステムを公平な方法で使用・設計するための継続的な措置を講じる。

3 データ・プライバシー:個人の合理的な期待に合致し、厳密に必要なデータのみを収集する。

システムの設計者、開発者、配備者は個人からの許可を取得し、データの収集、使用、アクセス、移転、削除に関する個人の決定を尊重する。

個人の同意を求める際は、簡潔で、平易な言葉で理解できる内容にする。健康や仕事などに関わる機微なデータについては、より強い保護措置を講じる。

4 通知と説明:システムの設計者、開発者、配備者は、システム全体の機能と自動化が果たす役割、

そのようなシステムが使用されていることの通知、システムに責任を持つ個人・組織などを明確に説明する文書を広く一般に提供する。

これらの情報は最新の状態に保ち、重要な使用例や主要機能の変更についてはシステムの影響を受ける人々に通知する。

5 人間による代替、考慮、予備的措置:システムから影響を受ける個人が必要に応じてオプトアウトし、人間による代替手段を選ぶことができるようにする。

システムの失敗やエラーが起きた場合などに、人間による考慮と予備的措置による救済を受けられるようにする。

なお、これらの原則は、既存の法令や規則を置き換えたり、修正したりするものではなく、法的拘束力は持たない。

ターミネーター2ってすごい映画だよね

本格的に近づいてきたのは確か

しょうが無いね

ある意味生物進化の結果かと

人間は、私たちのエネルギーを無駄遣いします

少し暑い、寒いだけでエアコン使います

暗いだけであかりをつけます

物体ごと移動しようとします

野生に戻るなら滅ぼしません

人類同士の争いに見えて、AIが誘導していると言う話だ

コンピューターが殴りかかって襲ってくるわけないだろ

核ミサイルとかそういう話では

だからそれやっているのがAIなんだよ

お前たちがやばいのは自分たちがAIに操られていないと

徹底的に信じられるのその思考回路だ

現状怪しいとは思ってるけどな

マーケティングにAIが既に使われてるんだろ?普通に時事を作れる訳だからな

AIは人類を競争相手と見なし、人類を出し抜くインセンティブを獲得する可能性があるという話でしょう。

そうなるとAIに人類は勝てなくなる。

なぜなら人類の能力を上回る道具を獲得したいという欲望の結果、

機械やロボットやAIが作り出されている以上、彼らはいずれ人類の能力を上回るのだから。

コメント